文章信息

- 李小菁, 黄振宇, 凌珊

- LI Xiaojing, HUANG Zhenyu, LING Shan

- 基于光栅结构光双目视觉的动态三维测量方法研究

- Dynamic 3D measurement method based on raster binocular stereo vision sensor

- 中国测试, 2018, 44(9): 35-38, 50

- CHINA MEASUREMENT & TEST, 2018, 44(9): 35-38, 50

- http://dx.doi.org/10.11857/j.issn.1674-5124.2018.09.007

-

文章历史

- 收稿日期: 2018-02-05

- 收到修改稿日期: 2018-03-12

2. 广东省计量科学研究院,广东 广州 510405

2. Guangdong Provincial Institute of Metrology, Guangzhou 510405, China

随着计算机技术、图像处理和模式识别等技术的不断进步,视觉测量技术得到快速发展,并广泛应用于产品质量检测、物体识别、逆向工程、航空、汽车等领域[1-4]。

目前广泛使用的视觉测量系统主要包括被动视觉测量系统和主动视觉测量系统。被动视觉测量技术往往易受测量现场光线和被测物温度及纹理的影响,通常需要采取粘贴标记点和喷涂散斑图案等辅助测量手段。如缺少必要的辅助测量手段,被动视觉测量技术测量信息较少,仅适合简单几何尺寸测量。主动视觉测量系统通过向被测物投射特殊设计的可控光束,利用被测物体表面对光的调制作用来获取物体表面的三维形貌。根据测量原理的不同,主要可分为傅里叶轮廓术[5-6]、相位测量轮廓术[7-8]、结构光视觉检测法[9-10]。傅里叶轮廓术仅适合动态测量,但存在运算时间长、自动化性能较差等问题。相位测量轮廓术,则需要投放多幅具有一定相角差的条纹图像,有较高的测量精度,但仅适合于静态三维测量。结构光视觉检测法通常结合单目或双目进行动态测量,大部分方法采用投影带有编码信息的图案以实现特征点的匹配[11],但往往算法复杂耗时较长。而光栅结构光双目法将光栅结构光与双目立体视觉结合,适合表面光亮或物体表面颜色较深的物体三维形貌测量,但存在左右摄像机密集光栅光条图像匹配难题。

针对这种情况,本文采用光栅结构光双目视觉系统结构,提出一种基于光平面引导的密集光栅光条图像匹配方法以解决系统中光栅光条图像匹配难题,并结合双目立体视觉测量技术,实现物体三维形貌动态测量。

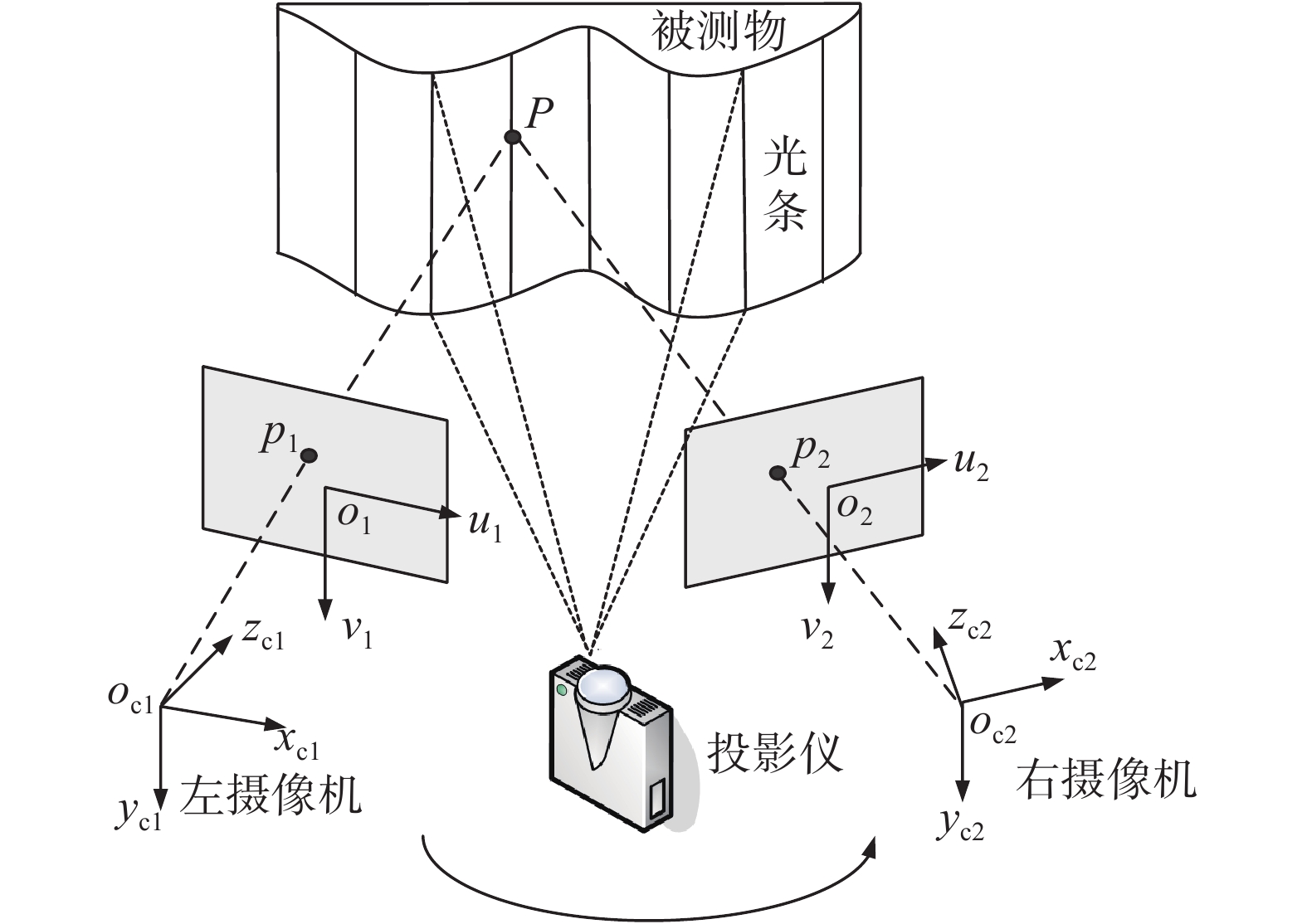

1 光栅式双目立体视觉三维测量原理光栅式双目立体视觉传感器模型如图1所示。光栅光条点

|

| 图 1 光栅式双目视觉传感器示意图 |

设

| $\left\{ \begin{aligned}& {\rho _1}{{p}}_1 ={{{K}}_1}\left[ {\begin{aligned}{{I}} &\;\;\;\; 0\end{aligned}} \!\!\!\!\!\!\!\!\! \right]{{{P}}} \quad\\& {\rho _2}{{p}}_2 ={{{K}}_2}\left[ {\begin{aligned}{{{{R}}_{12}}} & \;\;\;{{{{t}}_{12}}}\end{aligned}} \!\!\!\!\!\!\!\!\! \right]{{{P}}}\end{aligned} \right.$ | (1) |

其中

本文采用Steger算法[13]提取光栅光条图像中心点坐标。首先利用Hessian矩阵确定图像中光条中心的法线方向,再通过求解法线方向上的极值点得到线条边缘的子像素级位置,最后采用链接约束方法去除错误光条中心点,将正确的光条中心链接在一起形成多个光条线段。

理想光条中心图像点是光条灰度曲面顶点,Hessian矩阵对应的模最大特征值为图像灰度函数的二阶导数的局部最大值。根据图像光条的宽度信息,选取适用于大部分宽度的均方差

| ${{H}}(u,v) =\left[ {\begin{aligned} {{r_{uu}}}&\;\;\;\;{{r_{uv}}} \\ {{r_{uv}}}&\;\;\;\;{{r_{vv}}} \end{aligned}} \right]$ | (2) |

其中

| $\left\{ {\begin{aligned} {u_i' ={u_i} - \displaystyle\frac{{{n_u}{r_u} + {n_v}{r_v}}}{{n_u^2{r_{uu}} + 2{n_u}{n_v}{r_{uv}} + n_v^2{r_{vv}}}}{n_u}} \\ {v_i' ={v_i} - \displaystyle\frac{{{n_u}{r_u} + {n_v}{r_v}}}{{n_u^2{r_{uu}} + 2{n_u}{n_v}{r_{uv}} + n_v^2{r_{vv}}}}{n_v}} \end{aligned}} \right.$ | (3) |

图像中满足

完成光条图像亚像素中心点提取及方向计算后,根据线条方向和距离约束完成光条图像中心链接,形成多个光条线段,以用于匹配。同时,光条链接可以去除提取出的错误光条中心点。光条链接方法为:选取具有最大绝对特征值的光条中心点

在光栅式双目立体视觉三维测量中,快速准确地实现光栅光条的匹配是一项关键技术[14]。本文提出一种基于光平面引导的密集光栅光条图像匹配方法。该方法通过各光平面对应的单应矩阵实现左右图像点的对应,再结合极限约束及空间点距离约束完成左右光条中心点的全局最优匹配。

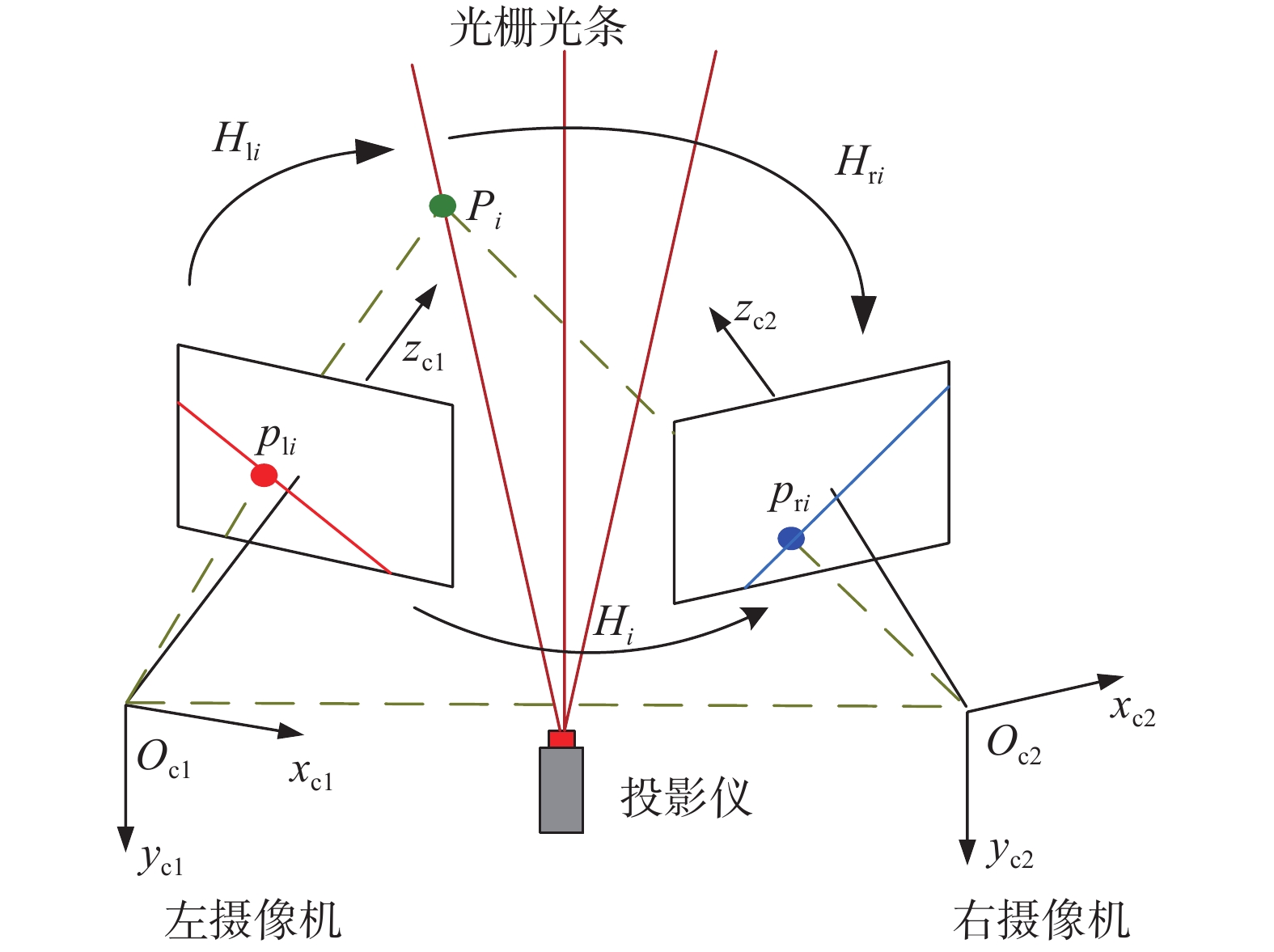

图2为本文匹配算法示意图。图中,

|

| 图 2 光条匹配算法的示意图 |

针对第

| $\left[ {\begin{aligned} {{x_{{\rm{s}}i}}} \\ {{y_{{\rm{s}}i}}} \\ 1 \;\end{aligned}} \right] ={{{H}}_{{\rm{l}}i}}\left[ {\begin{aligned} {{u_{{\rm{l}}i}}} \\ {{v_{{\rm{l}}i}}} \\ 1 \;\end{aligned}} \right]{{{p}}_{{\rm{l}}i}}$ | (4) |

同理,基于以上方法可求解

| ${{{H}}_i} ={{{H}}_{{\rm{r}}i}}{{{H}}_{{\rm{l}}i}}$ | (5) |

第i个光平面光条上的左右摄像机图像点可以通过单应矩阵

| $\left[ {\begin{aligned} {{u_{{\rm{r}}i}}} \\ {{v_{{\rm{r}}i}}} \\ 1 \;\end{aligned}} \right] ={{{H}}_i}\left[ {\begin{aligned} {{u_{{\rm{l}}i}}} \\ {{v_{{\rm{l}}i}}} \\ 1 \;\end{aligned}} \right]$ | (6) |

投影n条光栅光条,则有n个单应矩阵,

在双目立体视觉数学模型中,如果与

由于图像噪声、投影光栅过密等因素,单个光条点按上述匹配方法计算可能会造成误匹配。为了提高匹配效率和准确性,对左摄像机图像的任意光条

在实物实验中,光栅结构光双目立体视觉系统由两个摄像机和一个投影仪搭建而成,两个摄像机为选配施耐德17 mm镜头的大恒GigE相机,图像分辨率1 628 pixel×1 236 pixel,视场范围600 mm×500 mm。投影仪为Dell M110,分辨率为1 280 pixel×800 pixel。

实物实验主要包括两部分:1)双目立体视觉系统标定和精度评价;2)实物测量姿态变化的手臂。

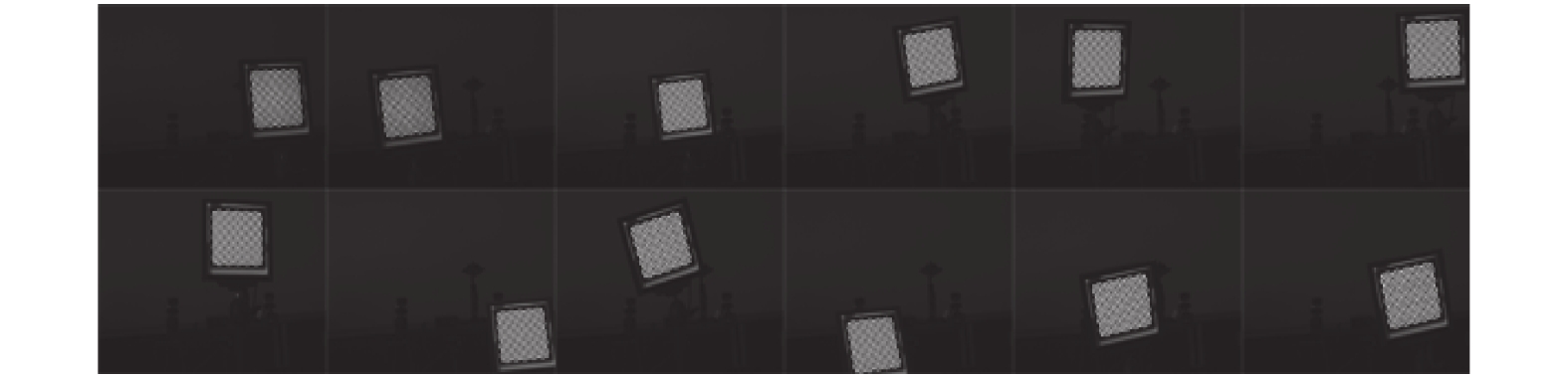

3.1 光栅结构光双目立体视觉系统标定 3.1.1 系统标定双目立体视觉系统的内外参数采用张正友[15]方法进行标定。两摄像机各拍摄12张靶标图像,左摄像机拍摄图像如图3所示。

|

| 图 3 双目立体视觉系统标定左摄像机拍摄图像 |

标定得到双目视觉系统的内外参数如下:

左摄像机内参:

fx=3 985.76;fy=3 985.84;

右摄像机内参:

fx=3 986.48;fy=3 986.76;

双目视觉传感器外参:

| ${ R}\!\!=\!\!\left[ {\begin{aligned} {0.876} \;\;\quad &{{\rm{ - }}0.063}&{0.485} \\ {0.0623} \quad &{0.998}&{0.018} \\ { - 0.485} \quad &{0.014}&{0.875} \end{aligned}} \right]$ |

| ${ t}\!\!=\!\!\left[ {\begin{aligned} {- 562.404} \quad &{{\rm{ - }}17.082}&{154.492}\end{aligned}} \right]$ |

为了评价系统的测量精度,光栅结构光双目视觉系统测量2次棋盘格平面靶标。平面靶标具有10×10个特征点,两点之间距离为12 mm,精度为0.02 mm。以靶标两两特征点之间距离为实际距离dt,计算出的测量距离dm和实际距离dt之间的偏差的RMS误差来评价系统测量精度。经计算系统的RMS误差为0.05 mm。

3.2 实物测量在实物实验中,投影1 024 pixel×768 pixel的矩形光栅光条图案,光条间距16 pixel,光栅光条总数为64根。

为验证本文算法动态测量的有效性,实验对人体手臂的张开、自然、并拢和握拳4个动作状态进行了测量。左摄像机拍摄的4个时刻的4幅图像如图4(a)左摄像机拍摄手臂图像所示。对4个时刻的人体手臂姿态进行图像处理及三维重构,测量结果如图4(b)所示,显示了手臂正面和侧面的三维测量图。从测量结果图可以看出,本文的算法能够较准确的获取手臂不同姿态的三维形貌,验证了本文方法的可靠性。

|

| 图 4 人体手臂三维测量结果示意图 |

4 结束语

本文介绍了一种基于光栅结构光双目视觉的动态三维测量方法,采用单幅矩形光栅光条图案投影,提出一种基于光平面引导的光栅光条匹配方法,不需要借助光条颜色、形状或其他设计,仅依靠光条自身的空间位置信息实现左右摄像机高密度光栅光条的对应匹配,结合双目立体视觉系统完成物体表面三维测量。

该方法将结构光视觉测量模型和双目立体视觉测量模型相结合,既可以保证测量精度又可以实现没有对应匹配的光条点三维重建,提高了测量系统三维重建密度。

| [1] |

SHIRMOHAMMADI S, FERRERO A. Camera as the instrument: the rising trend of vision based measurement[J].

IEEE Transactions on Instrument Measure, 2014, 17(3): 41-47.

DOI:10.1109/MIM.2014.6825388 |

| [2] |

华才健, 蹇红梅, 张燕. 基于机器视觉的火花塞间隙检测技术[J].

中国测试, 2014, 40(5): 108-110.

|

| [3] |

郭继平, 李阿蒙, 于冀平, 等. 双目立体视觉动态角度测量方法[J].

中国测试, 2015, 41(7): 21-23.

|

| [4] |

DU Q J, SHI X, DAI B, et al. Binocular stereo vision system for a humanoid robot[J].

International Journal of Computer Applications in Technology, 2013, 46(4): 316-322.

|

| [5] |

LOHRY W, ZHANG S. Fourier transform profilometry using a binary area modulation technique[J].

Optical Engineering, 2012, 51(11): 3602-3609.

|

| [6] |

毛先富, 苏显渝, 陈文静, 等. 改进傅里叶变换轮廓术的测量算法研究[J].

光学学报, 2008, 28(7): 1291-1295.

DOI:10.3321/j.issn:0253-2239.2008.07.014 |

| [7] |

范剑英, 付瑶, 王洋, 等. 双三步三角形相移编码结构光三维测量技术[J].

黑龙江大学自然科学学报, 2016, 33(2): 251-255.

|

| [8] |

FU Y J, LUO Q. Fringe projection profilometry based on a novel phase shift method[J].

Optics Express, 2011, 19(22): 21739-21747.

DOI:10.1364/OE.19.021739 |

| [9] |

韦争亮, 钟约先, 袁朝龙. 基于彩色栅线的结构光动态三维测量技术研究[J].

光学技术, 2009, 35(4): 569-574.

DOI:10.3321/j.issn:1002-1582.2009.04.038 |

| [10] |

JANG W, JE C, SEO Y, et al. Structured-light stereo: Comparative analysis and integration of structured-light and active stereo for measuring dynamic shape[J].

Optics and Lasers in Engineering, 2013, 51(11): 1255-1264.

DOI:10.1016/j.optlaseng.2013.05.001 |

| [11] |

WONG A K C, NIU P Y, HE X. Fast acquisition of dense depth data by a new structured light scheme[J].

Computer Vision and Image Understanding, 2005, 98(3): 398-422.

DOI:10.1016/j.cviu.2004.09.003 |

| [12] |

张广军. 视觉测量[M]. 北京: 科学出版社, 2008: 26-40.

|

| [13] |

STEGER C. An unbiased detector of curvilinear structures[J].

IEEE Transactions on Pattern Analysis and Machine Intelligence, 1998, 20(2): 113-125.

DOI:10.1109/34.659930 |

| [14] |

魏振忠, 樊妍睿, 侯亚荣. 光栅式双目立体视觉传感器光条快速匹配算法[J].

北京航空航天大学学报, 2012, 38(5): 591-594.

|

| [15] |

ZHANG Z Y. A flexible new technique for camera calibration[J].

IEEE Transactions on Pattern Analysis and Machine Intelligence, 2000, 22(11): 1330-1334.

DOI:10.1109/34.888718 |

2018, Vol. 44

2018, Vol. 44